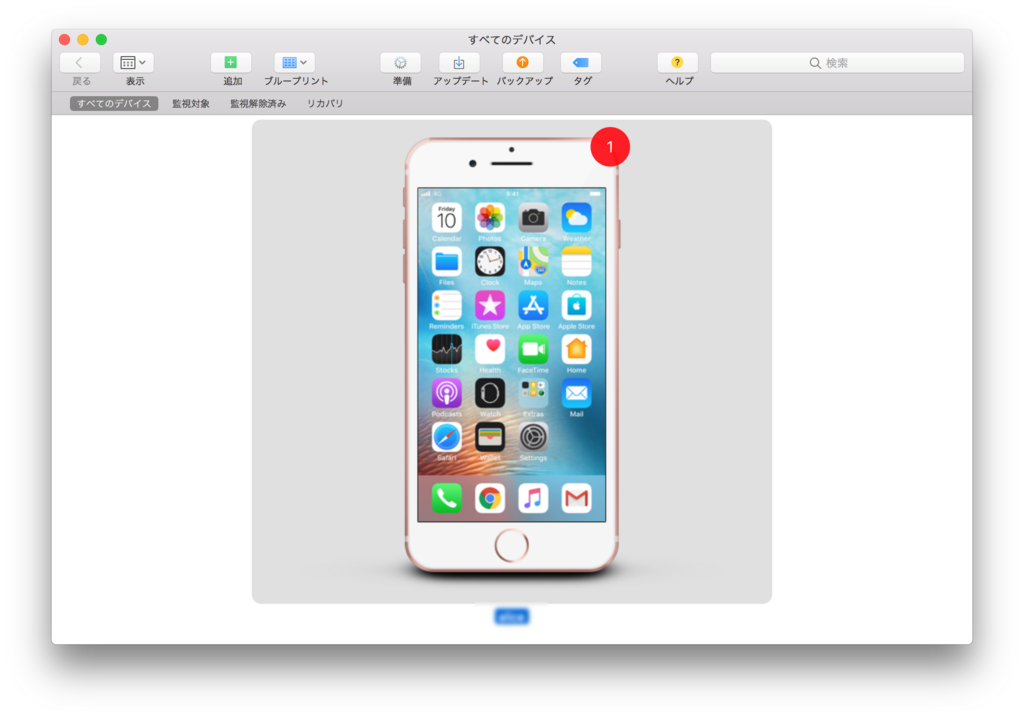

TOTP について調べるため、AWS の MFA で使うことのできる 仮想 MFA アプリケーションと同様の機能を持つアプリケーションを作成してみました。

TOTP の仕様

- RFC 4226: HOTP: An HMAC-Based One-Time Password Algorithm

- RFC 6238: TOTP: Time-Based One-Time Password Algorithm

使い方

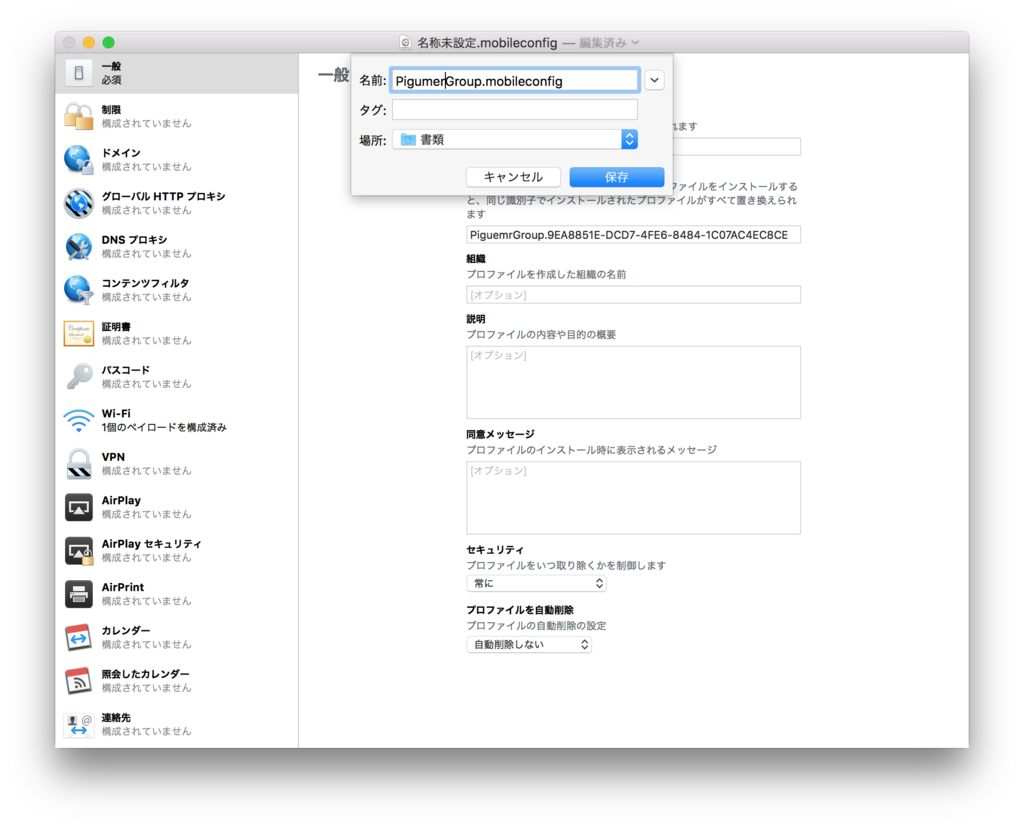

ユーザのホームディレクトリに .onetime というディレクトリを作成し、そのディレクトリに onetime.properties というファイルを作成します。

$ mkdir ~/.onetime $ cat > ~/.onetime/onetime.properties

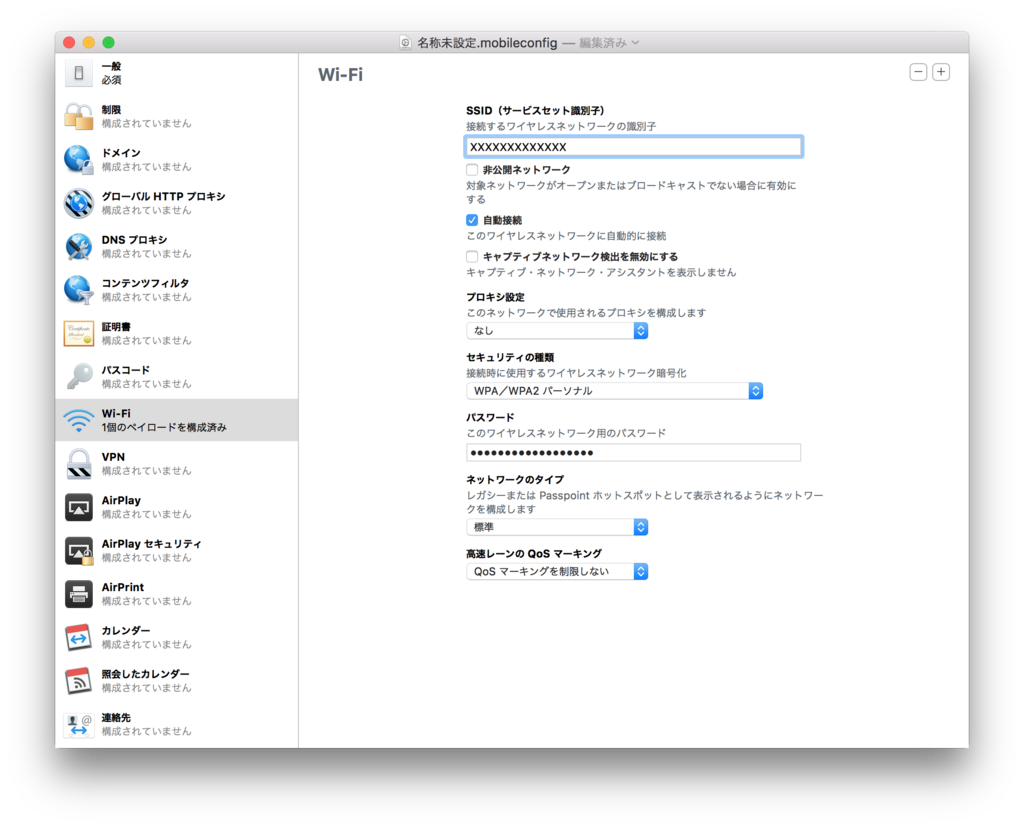

onetime.properties には、AWS の MFA を有効にしたときに表示されるシークレットキーを設定します。

secret=XXXXXXXXXXXXXXXXXXXXXXXXXXXXXXXXXXXXX